Digitaalinen maailma kehittyy jatkuvasti, ja yksi katalysaattori, joka erottaa tämän alustan muista käyttäjien luomaa sisältöä. Vaikka yrityksillä ympäri maailmaa on verkkosivustonsa ja oma sosiaalinen mediansa, käyttäjät luottavat todennäköisemmin muiden asiakkaiden mielipiteisiin kuin noudattavat yrityksen sanoja.

Yli 4.26 miljardia ihmistä olivat aktiivisia sosiaalisen median käyttäjiä vuonna 2021. Lukujen ennustetaan saavuttavan 6 miljardin rajan vuoteen 2027 mennessä. Maailmanlaajuisesti tuotetun, kaapatun, jaetun ja kulutetun sisällön määrä ylitti 64.2 settaatavua vuonna 2020.

Kun uutta sisältöä tuotetaan ja kulutetaan huimaa vauhtia, on tullut välttämättömäksi, että brändit seuraavat alustoillaan isännöityä sisältöä. Online-alustat pitäisi olla ja pysyä turvallisena ympäristönä käyttäjilleen.

[Lue myös: Automaattisen sisällön moderoinnin ymmärtäminen]

Mitä sisällön moderointi on ja miksi?

Käyttäjien luoma sisältö kannustaa sosiaalisen median alustoja ja sisällön maltillisuus viittaa tämän sisällön seulomiseen sopimattomien tai loukkaavien viestien varalta. Yritys- ja sosiaalisen median alustoilla on erityinen standardi isännöintisisällön seurantaan.

Ohjeet voivat sisältää mitä tahansa väkivallasta, ääriliikkeistä, vihaan, alastomuutta, tekijänoikeusrikkomusta tai muuta loukkaavaa. Lähetetty sisältö merkitään ja poistetaan, jos se ei täytä standardia.

Sisällön moderoinnin ideana on varmistaa, että sisältö on brändin ihanteiden mukainen ja kunnioittaa säädyllisyyden, luottamuksen ja turvallisuuden arvoja.

Sisällön moderointi on elintärkeää yrityksille, jotta ne säilyttävät liiketoimintastandardit, tuotekuvan, maineen ja uskottavuuden. Joka sekunti käyttäjien luoman, alustoille lähetetyn sisällön hämmästyttävä määrä tekee brändeille haastavaa pysyä poissa loukkaavasta ja sopimaton sisältö, tekstiä, videoita ja kuvia. Sisällön valvontastrategia auttaa brändejä ylläpitämään imagoaan samalla, kun käyttäjät voivat ilmaista itseään ja sulkea loukkaavan, avoimen ja väkivaltaisen sisällön.

Mitä sisältötyyppejä voit valvoa?

Sisällönvalvontaalgoritmit käsittelevät yleensä kolmea näistä sisältötyypeistä tai niiden yhdistelmää.

teksti

Valtava määrä tekstiä – kommenteista täyspitkiin artikkeleihin – joka vaatii moderointia, on melko hätkähdyttävä. Tekstiviestit ovat saatavilla melkein missä tahansa kommenttien, artikkelien, foorumiviestien, sosiaalisen median keskustelujen ja muiden julkaisujen muodossa.

Tekstisisällön moderointialgoritmien pitäisi pystyä skannaamaan eripituinen ja -tyylinen teksti ei-toivotun sisällön varalta. Lisäksi tekstin moderointi voi olla vaikea tehtävä kielen ja kulttuuristen vivahteiden monimutkaisuuden vuoksi.

kuvat

Kuvan moderointi on paljon yksinkertaisempaa kuin tekstin, mutta on tärkeää, että sinulla on asianmukaiset ohjeet tai standardit.

Lisäksi, koska kulttuurierot voivat tulla esille kuvien moderoinnin yhteydessä, on tärkeää ymmärtää perusteellisesti käyttäjäyhteisö ja olla yhteydessä useisiin maantieteellisiin kohteisiin.

Videoita

Videosisällön valvominen on erittäin vaikeaa, koska videoiden valvominen voi olla aikaa vievää, toisin kuin teksti tai kuvat. Moderaattorin on katsottava koko video, ennen kuin se katsoo sen kulutukseen kelpaamattomaksi tai kelpaamattomaksi. Vaikka vain muutama ruutu videossa olisi selkeää tai häiritsevää, se pakottaa moderaattorin poistamaan koko sisällön.

Live Streaming

Suoratoisto on ehkä haastavin sisältö moderoitavaksi. Tämä johtuu siitä, että videon ja siihen liittyvän tekstin moderoinnin on tapahduttava samanaikaisesti suoratoiston kanssa.

Miten sisällön valvonta toimii?

Jotta voit aloittaa sisällön valvomisen alustallasi, sinun tulee ensin ottaa käyttöön standardeja tai ohjeita, jotka määrittävät sopimattoman sisällön. Nämä ohjeet auttavat valvojia ilmoittamaan sisällön poistettavaksi.

Määritä herkkyystaso tai kynnysarvo, joka sisällön valvojien tulee ottaa huomioon arvioidessaan sisältöä. Kynnys tulee määrittää brändisi, liiketoimintasi tyypin, käyttäjien odotusten ja sijainnin perusteella.

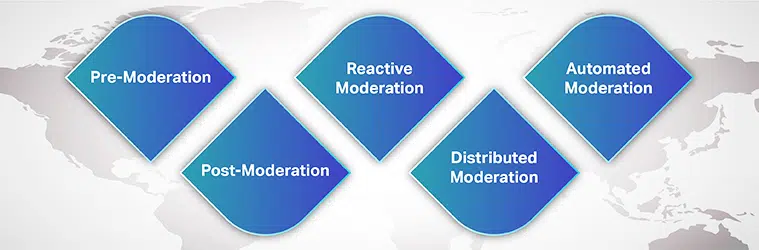

Sisällön moderoinnin tyypit

Voit valita monista maltilliset prosessit brändisi tarpeisiin ja käyttäjän suostumus. Jotkut niistä ovat:

Esivalvonta

Ennen kuin sisältö näytetään sivustollasi, se on valvontajonossa. Vasta sen jälkeen, kun sisältö on tarkistettu ja todettu kulutukseen sopivaksi, se julkaistaan alustalla. Vaikka tämä on turvallinen tapa estää seksuaalista sisältöä, se on aikaa vievää.

Jälkivalvonta

Jälkivalvonta on tavallinen sisällön valvontamenetelmä, jossa käyttäjän sitoutumisen ja valvomisen välillä on kompromissi. Vaikka käyttäjät voivat lähettää palautetta, se on silti jonossa valvontaa varten. Jos sisältö on merkitty, se tarkistetaan ja poistetaan. Yritykset pyrkivät lyhentämään tarkistusaikaa, jotta sopimaton sisältö ei jää verkossa liian pitkään.

Reaktiivinen moderointi

Reaktiivisessa moderaatiossa käyttäjäyhteisöä kehotetaan ilmoittamaan sopimattomasta sisällöstä, joka loukkaa yhteisöä säännöt ja ohjeet. Tällä menetelmällä yhteisön huomio kiinnitetään sisältöön, joka vaatii moderointia. Loukkaava sisältö saattaa kuitenkin jäädä alustalle pidempään.

Jaettu moderointi

Hajautetun valvontamenetelmän avulla verkkoyhteisö voi tarkistaa, merkitä ja poistaa loukkaavana ja ohjeiden vastaista sisältöä luokitusjärjestelmän avulla.

Automaattinen moderointi

Kuten nimestä voi päätellä, automaattinen valvonta käyttää erilaisia työkaluja ja järjestelmiä sanojen tai lauseiden merkitsemiseen ja lähetysten hylkäämiseen. Se toimii suodattamalla tietyt kielletyt sanat, kuvat ja videot koneoppimisalgoritmeilla.

Vaikka teknologiapohjainen maltillisuus on yleistymässä, inhimillinen maltillisuus tarkistusta ei voida jättää huomiotta. Ihannetapauksessa yritykset käyttävät automaattisten työkalujen ja ihmisten moderaattoreiden yhdistelmää ainakin monimutkaisissa tilanteissa.

[Lue myös: Tapaustutkimus – sisällön moderointi]

Miten koneoppiminen auttaa sisällön moderointia?

Koska yli 5 miljardia ihmistä käyttää Internetiä ja yli 4 miljardia aktiivista sosiaalisen median verkostoissa, ei ole helppoa hämmästyä päivittäin syntyvien kuvien, tekstien, videoiden, viestien ja viestien valtavasta määrästä. Tätä äärimmäistä sisältöä on moderoitava jollain tavalla, jotta heidän sosiaalisen median sivustoillaan käyvillä käyttäjillä on miellyttävä ja rikastuttava kokemus.

Sisällön moderointi otettiin käyttöön ratkaisuna sellaisen sisällön poistamiseen, joka on selkeää, loukkaavaa, loukkaavaa, huijaavaa tai brändin eetoksen vastaista. Perinteisesti yritykset ovat luottaneet täysin ihmisten moderaattoreihin arvioidakseen käyttäjien luomaa online-sisältöä, joka on julkaistu niiden alustoilla. Täysin ihmisistä riippuvainen moderaattori voi kuitenkin tehdä prosessista aikaa vievän, kalliin ja tehottoman.

Yritykset käyttävät nyt koneoppimisalgoritmeja sisällön automaattiseen ja tehokkaaseen moderointiin. AI-käyttöinen sisällön moderointi on tehnyt koko prosessista tehokkaan, nopeamman, johdonmukaisen ja kustannustehokkaan.

Vaikka tämä prosessi ei poista ihmisten moderaattoreiden tarvetta – ihminen silmukassa, ihmisten moderaattorien panos auttaa käsittelemään monimutkaisia asioita. Lisäksi ihmismoderaattorit ymmärtävät paremmin kielen vivahteita, kulttuurisia eroja ja kontekstia. Kun käytetään automatisoituja työkaluja ihmisten moderaattorien avulla, se vähentää laukaisevalle sisällölle altistumisen psykologista vaikutusta.

Sisällön moderoinnin haasteet

Toinen suuri haaste tarkan sisällönvalvontaalgoritmin kehittämisessä on kieli. Luotettavan sisällönvalvontasovelluksen tulee pystyä tunnistamaan useita kieliä ja ymmärtämään kulttuurisia vivahteita, sosiaalisia konteksteja ja kielellistä dynamiikkaa.

Koska kieli käy läpi useita muutoksia ajan myötä, koska tietyt eilen viattomat sanat olisivat voineet ansaita mainetta tänään – ML-mallin on pysyttävä muuttuvan maailman tahdissa. Esimerkiksi alastonmaalaus voi olla selkeä ja tirkistelijä tai yksinkertaisesti taide.

Miten a osa sisältöä koetaan tai katsotaan sopimattomaksi, riippuu kontekstista. Ja on ratkaisevan tärkeää, että alustassasi on johdonmukaisuus ja standardit, jotta käyttäjäsi voivat luottaa moderointiponnisteluihin.

Tyypillinen käyttäjä yrittää aina löytää porsaanreikiä ohjeissasi ja ohittaa moderointisäännöt. ML-algoritmissi pitäisi kuitenkin pystyä kehittymään jatkuvasti muuttuvien aikojen mukana.

Lopuksi kysymys on puolueellisuudesta. Harjoittelutietokannan ja koulutusmallien monipuolistaminen kontekstin havaitsemiseksi on erittäin tärkeää. Vaikka luotettavan sisällönvalvontaalgoritmin kehittäminen saattaa tuntua haastavalta, se alkaa laadukkaiden koulutustietosarjojen hankkimisesta.

Kolmannen osapuolen toimittajat, joilla on oikea asiantuntemus ja kokemus riittävien koulutustietojoukkojen toimittamisesta, ovat oikea paikka aloittaa.

Jokainen yritys, jolla on sosiaalinen läsnäolo, tarvitsee huippuluokan sisällön moderointiratkaisu joka auttaa rakentamaan asiakkaiden luottamusta ja moitteetonta asiakaskokemusta. Sovelluksen rakentamiseksi ja koneoppimismallin kouluttamiseksi tarvitset pääsyn korkealaatuiseen tietokantaan, jossa ei ole ennakkoluuloja ja joka on linjassa uusimpien kielitieteen ja markkinakohtaisten sisältötrendien kanssa.

Vuosien kokemuksemme avulla autamme yrityksiä käynnistämään tekoälymallit, Shaip tarjoaa kattavat tiedonkeruujärjestelmät erilaisiin sisällönvalvontatarpeisiin.